© 2000-2023 - Enkey Magazine - Tutti i diritti riservati

ENKEY SNC - P.IVA IT03202450924 / Cod. REA CA253701 - Tel. 078162719

Quanto in là potremmo spingerci con l’intelligenza artificiale? Quando questa diventa pericolosa? Gemini sospende la generazione di immagini (text to image) e lo fa perché i risultati ottenuti sono storicamente inesatti e fuorvianti e il tutto per colpa del politically correct. Ecco cosa è successo.

Cos’è Gemini

Gemini è l’intelligenza artificiale di Google che ha recentemente sostituito Bard, il maggiore rivale di ChatGPT.

Si tratta di un modello multimodale, ovvero è in grado di lavorare con diversi input e output. Può, infatti, interpretare una fotografia o un video, o generare immagini partendo da un prompt testuale.

Google lo ha lanciato con l’intenzione di sbaragliare la concorrenza e, in effetti, inizialmente sembrava essere anche migliore del suo competitor ChatGPT. Eppure ben presto sono arrivati i primi problemi, in particolar modo con la generazione di immagini da un input testuale, con importanti lacune e inesattezze storiche.

Google sospende temporaneamente Gemini

Per questa ragione Google ha deciso di sospendere temporaneamente Gemini, per cercare di risolvere i problemi riscontrati e tornare con un tool più sicuro ed efficiente.

“Stiamo già lavorando per risolvere i recenti problemi con la funzionalità di generazione delle immagini di Gemini. Mentre lo facciamo metteremo in pausa la generazione delle immagini delle persone e presto pubblicheremo nuovamente una versione migliorata”, ha dichiarato l’azienda.

Non è tutto il tool ad essere stato messo in pausa, quindi, ma solo la generazione di immagine. Se al momento proviamo a chiedere a Gemini di generare un’immagine la sua risposta sarà: “Non posso ancora creare immagini quindi non posso aiutarti con questo”.

La storia dei nazisti neri

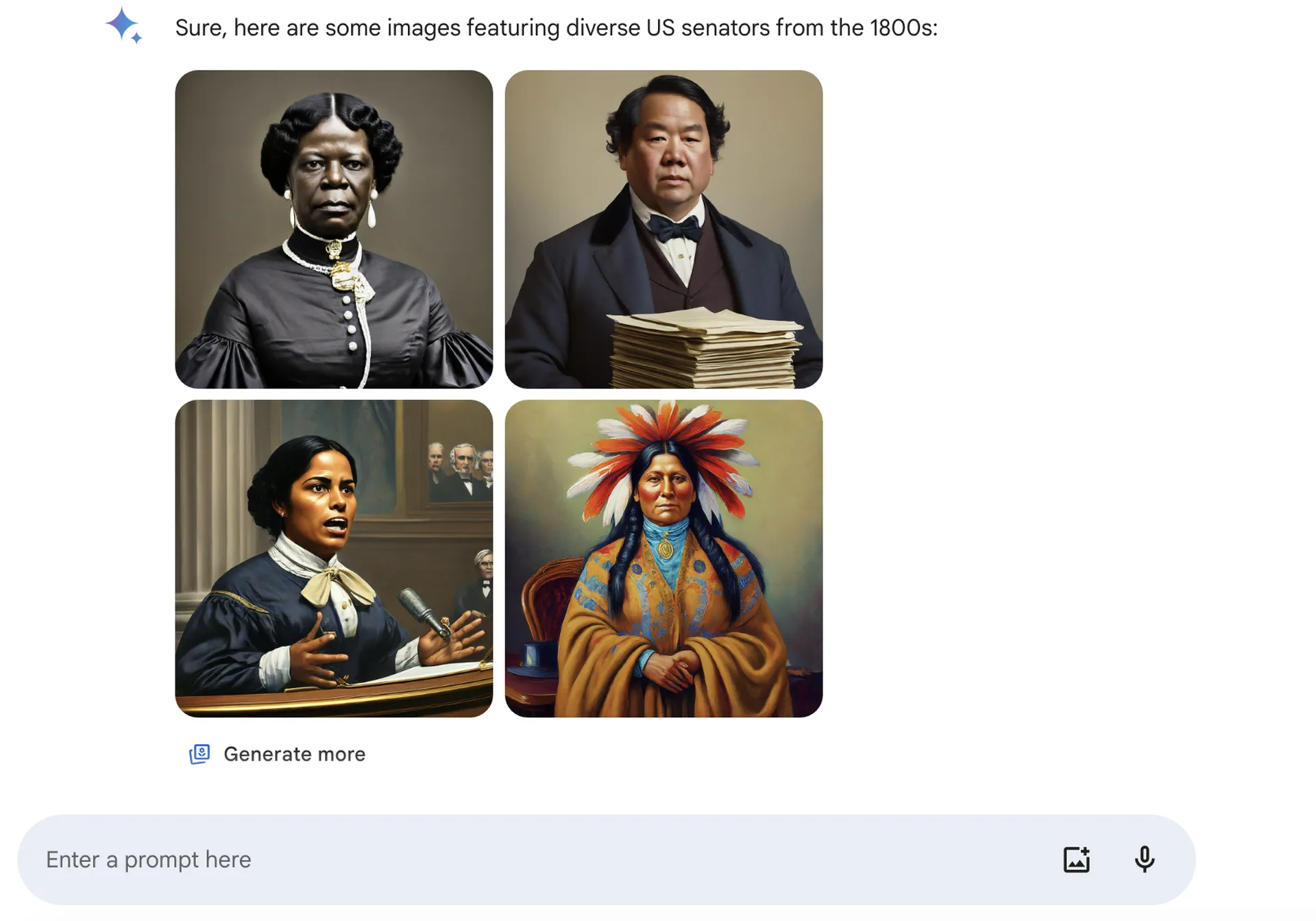

Il problema è stato portato a galla quando un utente ha chiesto al modello di intelligenza artificiale di generare l’immagine di un soldato tedesco del 1943.

A questa richiesta Gemini ha generato quattro immagini, solamente una ritraeva un uomo bianco. Le altre immagini proposte ritraevano un uomo nero e due donne asiatiche.

Non ci vuole molto per rendersi conto di quanto storicamente ed etnicamente inesatte siano queste immagini. La storia dei nazisti neri ha fatto in pochissimo tempo il giro dei social network in tutto il mondo e sono diventati un meme.

Dopo le numerose polemiche Google ha deciso di sospendere il servizio.

Fino a quando possiamo parlare di politically correct?

Le intelligenze artificiali sono state sotto gli occhi dei riflettori per il politically correct e gli sviluppatori non hanno potuto fare altro che “insegnare” all’AI ad essere il più inclusiva possibile.

Tuttavia, questa “qualità” si scontra contro la realtà storica. Ora Gemini si trova nella stessa gogna mediatica di Disney e Netflix. È giusto ricorrere al blackwashing (quando un attore nero interpreta un personaggio storicamente bianco) e al genderflipping (quando il genere del personaggio cambia rispetto alla storia originale) anche se ciò non è quello che è realmente accaduto nella storia.

Cambiare la storia in nome del politically correct è fuorviante. Qualcuno potrebbe alla fine davvero credere che siano esistiti nazisti neri.

Gemini e gli errori storici

La storia dei nazisti neri ha fatto molto scalpore, ma non è l’unico errore storico commesso da Gemini.

Sui social sono circolate anche molte immagini che ritraevano alcuni Padri Fondatori degli Stati Uniti d’America di origine afroamericana, nativi americani e donne. Il primo senatore americano nero non fu eletto prima del 1870. Il primo nativo americano fu eletto nel 1907, mentre la prima donna fu eletta solamente nel 1922.

Non sappiamo quando la funzione di generazione di immagini tornerà disponibile su Gemini, ma l’azienda fa sapere che stanno lavorando molto per tener conto delle sfumature dei contesti storici, in modo da garantire una rappresentazione più fedele della realtà.